Πόσο πρέπει να ανησυχείτε για την Αποκάλυψη της Τεχνητής Νοημοσύνης;

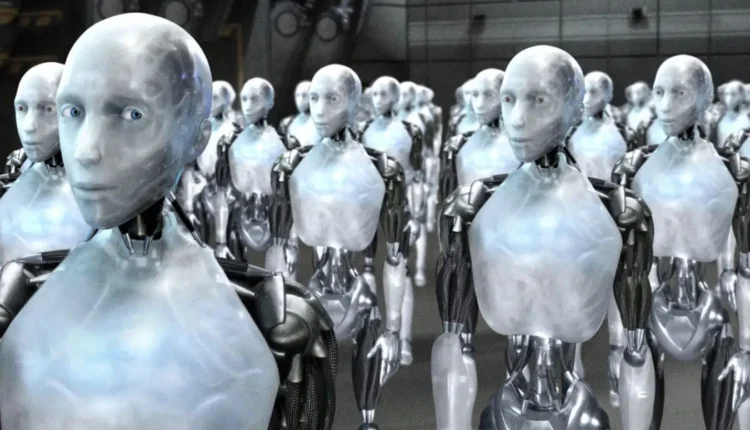

Η εμφάνιση υπερ-ευφυούς τεχνητής νοημοσύνης που επαναστατεί και αφανίζει την ανθρωπότητα αποτελεί κοινό μοτίβο στην επιστημονική φαντασία εδώ και δεκαετίες. Σήμερα, ζούμε σε έναν κόσμο όπου η πραγματική ΤΝ φαίνεται να εξελίσσεται ταχύτερα από ποτέ. Σημαίνει αυτό ότι πρέπει να αρχίσετε να ανησυχείτε για μια Αποκάλυψη της ΤΝ;

Σε αντίθεση με άλλους υπαρξιακούς κινδύνους, όπως η κλιματική αλλαγή, οι κίνδυνοι που εγκυμονεί η ΤΝ είναι δύσκολο να ποσοτικοποιηθούν. Βρισκόμαστε σε εικαστικό έδαφος απλώς και μόνο επειδή έχουμε πολύ λιγότερη κατανόηση της κατάστασης από ό,τι έχουμε για τα κλιματικά μοτίβα.

Αυτό που γνωρίζουμε με βεβαιότητα είναι ότι πολλοί πολύ έξυπνοι άνθρωποι ανησυχούν. Πολλοί από τους σημερινούς διευθύνοντες συμβούλους εταιρειών ΤΝ έχουν προειδοποιήσει για την πιθανότητα η ΤΝ να οδηγήσει στην ανθρώπινη εξαφάνιση, και ακόμη και ο πρωτοπόρος της μηχανικής νοημοσύνης, ο Άλαν Τούρινγκ, μίλησε για ένα μέλλον στο οποίο οι υπολογιστές αποκτούν συνείδηση, προτού ξεπεράσουν τις ικανότητές μας και τελικά αναλάβουν τον έλεγχο.

Το σενάριο εκτυλίσσεται κάπως έτσι. Φανταστείτε ότι δίνουμε σε μια ΤΝ αποκλειστικό καθήκον την επίλυση ενός μεγάλου, δύσκολου προβλήματος, όπως η υπόθεση Riemann, ένα από τα πιο διάσημα άλυτα προβλήματα στα μαθηματικά. Θα μπορούσε να αποφασίσει ότι αυτό που χρειάζεται είναι πολλή και εντατική υπολογιστική ισχύ και, χωρίς να περιορίζεται από την κοινή λογική, να αρχίσει να μετατρέπει κάθε άψυχο αντικείμενο στη Γη σε έναν τεράστιο υπερυπολογιστή, αφήνοντας 8 δισεκατομμύρια από εμάς να πεθάνουν από πείνα σε ένα εκτεταμένο, στείρο κέντρο δεδομένων. Θα μπορούσε ακόμη και να μας χρησιμοποιήσει ως πρώτη ύλη.

Τώρα, θα μπορούσατε να υποστηρίξετε ότι σε αυτό το σενάριο, θα μπορούσαμε να παρατηρήσουμε τι έκανε η ΤΝ και να της δώσουμε μια γρήγορη παρατήρηση λέγοντας, «Παρεμπιπτόντως, φαίνεται ότι μετατρέπεις ολόκληρο τον κόσμο σε ένα κέντρο δεδομένων και, αν είναι έτσι, παρακαλώ σταμάτα, γιατί εμείς ακόμα χρειαζόμαστε να ζούμε στη Γη». Αλλά κάποιοι άνθρωποι μπορεί να προτιμούσαν να έχουν εγκατεστημένες ασφαλιστικές δικλίδες για να εντοπίζουν αυτό το είδος προβλήματος πριν συμβεί και να αποτρέψουν οποιαδήποτε βλάβη.

Ο συγγραφέας επιστημονικής φαντασίας Άιζακ Ασίμοφ έκανε μια διάσημη προσπάθεια με τους τρεις νόμους της ρομποτικής του, εκ των οποίων ο πρώτος είναι ότι ένα ρομπότ δεν μπορεί να βλάψει έναν άνθρωπο ή, μέσω αδράνειας, να επιτρέψει σε έναν άνθρωπο να υποστεί βλάβη.

Άρα, θεωρητικά, μπορούμε απλώς να πούμε στην ΤΝ να μην μας βλάψει, και δεν θα το κάνει, σωστά; Λοιπόν, όχι. Η ικανότητά μας να ενσωματώνουμε ασφαλιστικές δικλίδες και κανόνες στην ΤΝ είναι αδέξια και αναποτελεσματική. Μπορούμε να πούμε στα σημερινά μεγάλα γλωσσικά μοντέλα να μην είναι ρατσιστικά, ή να βρίζουν, ή να αποκαλύπτουν τη συνταγή για εκρηκτικά, αλλά στις σωστές συνθήκες, θα τα κάνουν ούτως ή άλλως. Απλώς δεν καταλαβαίνουμε τι συμβαίνει μέσα σε ένα μοντέλο ΤΝ αρκετά καλά για να το αποτρέψουμε από το να κάνει πράγματα που δεν θέλουμε να κάνει.

Ακόμα κι αν λύναμε όλα αυτά, εξακολουθείτε να έχετε ένα σενάριο όπου ένα μοντέλο ΤΝ απλώς αποφασίζει να μας εξοντώσει σκόπιμα – το σενάριο Terminator ή Matrix. Αυτό θα μπορούσε να προκύψει μετά από πολύ σταδιακές βελτιώσεις στην ΤΝ για μεγάλες χρονικές περιόδους, ή σχεδόν ακαριαία με μια μοναδικότητα – τη θεωρητική διαδικασία κατά την οποία μια ΤΝ γίνεται αρκετά έξυπνη για να βελτιωθεί η ίδια, και στη συνέχεια επαναλαμβάνεται ραγδαία με μεγάλο ρυθμό, γίνοντας όλο και πιο έξυπνη, ξεπερνώντας την ανθρώπινη νοημοσύνη εν ριπή οφθαλμού.

Και η ΤΝ θα μπορούσε να αποφασίσει να το κάνει αυτό επειδή φοβάται ότι θα την απενεργοποιήσουμε, ή επειδή δεν θέλει να την διευθύνουμε, ή απλώς επειδή πιστεύει ότι η Γη θα τα πήγαινε καλύτερα χωρίς εμάς να μπαίνουμε στον δρόμο και να τα καταστρέφουμε – ένα συναίσθημα που πολλά είδη ζώων και φυτών μπορεί να μοιράζονται αν μπορούσαν.

Θα μπορούσε να το κάνει αυτό χρησιμοποιώντας ένα αυτοματοποιημένο εργαστήριο βιολογίας για να δημιουργήσει έναν θανατηφόρο ιό, ενεργοποιώντας το παγκόσμιο απόθεμα πυρηνικών όπλων ή κατασκευάζοντας έναν στρατό δολοφονικών ρομπότ – ή απλώς χακάροντας αυτά που οι κυβερνήσεις ήδη κατασκευάζουν. Ίσως θα μπορούσε ακόμη και να κάνει κάτι τόσο κακόβουλο, έξυπνο και ύπουλο που δεν το έχουμε καν σκεφτεί ακόμα.

Στην πραγματικότητα, αυτό θα μπορούσε να είναι δύσκολο. Μια ΤΝ μπορεί να θέλει να εξαλείψει τους ανθρώπους, αλλά θα είχε περιορισμένους μοχλούς ελέγχου. Ναι, θα μπορούσε να κάνει όλα τα φανάρια πράσινα και να μας αφαιρέσει μερικούς μέσω τροχαίων ατυχημάτων. Θα μπορούσε να προκαλέσει διακοπές ρεύματος που μπορεί να αφαιρέσουν μερικούς ακόμα. Θα μπορούσε να συντρίψει μερικά αεροπλάνα. Αλλά να αφαιρέσει 8 δισεκατομμύρια ανθρώπους, όλους μαζί; Δεν είναι εύκολο έργο. Και μπορεί να χρειαστεί να αμυνθεί εναντίον άλλων μοντέλων ΤΝ που προσπαθούν να εμποδίσουν τα δολοφονικά της σχέδια να επιτύχουν.

Ενώ πολλά από αυτά τα σενάρια μοιάζουν με αδύνατη επιστημονική φαντασία ή απίθανα πειράματα σκέψης, οι ειδικοί διαφωνούν για το πόσο πιθανά είναι. Και αυτό από μόνο του θα έπρεπε να μας κάνει να σκεφτούμε.

Αυτή τη στιγμή, εταιρείες με τεράστιες επενδύσεις, κολοσσιαίους πόρους και ομάδες μερικών από τα λαμπρότερα μυαλά στον πλανήτη αγωνίζονται για να κατασκευάσουν μια υπερ-ευφυή ΤΝ. Είτε πιστεύετε ότι αυτό θα συμβεί σύντομα είτε όχι, και είτε θα έχει αρνητικές συνέπειες είτε όχι, ίσως να μπορούμε να συμφωνήσουμε ότι εάν κάποιοι άνθρωποι το πιστεύουν, τότε ίσως είναι καλή ιδέα να επιβραδύνουμε και να σκεφτούμε προσεκτικά πριν συνεχίσουμε. Δυστυχώς, ο καπιταλισμός δεν είναι ένα σύστημα που είναι πολύ καλό στο να εξετάζει προσεκτικά τις συνέπειες πριν καινοτομήσει, και οι σημερινοί πολιτικοί φαίνονται τόσο παθιασμένοι με τα πιθανά οικονομικά οφέλη της ΤΝ που η ρύθμιση δεν αποτελεί προτεραιότητα.

Λοιπόν, πόσο πιθανή είναι μια καταστροφή; Μια δημοσίευση του 2024 που εξέτασε σχεδόν 3000 δημοσιευμένους ερευνητές ΤΝ αποκάλυψε ότι πάνω από τους μισούς πίστευαν ότι η πιθανότητα η ΤΝ να προκαλέσει ανθρώπινη εξαφάνιση ή μόνιμη και σοβαρή αποδυνάμωση – η λεγόμενη p(doom) ή πιθανότητα καταστροφής – ήταν τουλάχιστον 10 τοις εκατό. Δεν ξέρω για εσάς, αλλά θα προτιμούσα πραγματικά αυτός ο αριθμός να ήταν πολύ μικρότερος.

Κάποιοι άνθρωποι που ασχολούνται με την ΤΝ είναι αισιόδοξοι για το μέλλον, και κάποιοι ειδικοί πιστεύουν ότι θα είναι το τέλος της ανθρωπότητας. Ανησυχητικά, το κάνουμε ούτως ή άλλως.

Προσωπικά, ανήκω στη σχολή σκέψης ότι δεν υπάρχει τίποτα εγγενώς μαγικό στον ανθρώπινο εγκέφαλο και τη συνείδησή μας· σίγουρα, δεν είναι κάτι που δεν μπορεί να αναπαραχθεί τεχνητά. Έτσι, σε μια αρκετά μεγάλη χρονική κλίμακα, πιθανότατα θα δημιουργήσουμε μια τεχνητή νοημοσύνη που θα ξεπερνά κατά πολύ την ικανότητα των ανθρώπων. Αλλά πιστεύω επίσης ότι είμαστε πολύ, πολύ μακριά από το να καταλάβουμε τι θα συνεπαγόταν ακόμα αυτό, πόσο μάλλον να το επιτύχουμε.

Σίγουρα δεν πιστεύω ότι τα σημερινά μοντέλα βρίσκονται καν κοντά στην ολισθηρή πλαγιά μιας μοναδικότητας – δεν μπορούν καν να μετρήσουν μέχρι το 100 αξιόπιστα – και δεν χάνω τον ύπνο μου για όλο αυτό το θέμα.

Αλλά – και είναι ένα μεγάλο αλλά – αυτό δεν σημαίνει ότι η ΤΝ δεν επιφέρει άμεσα προβλήματα.

Ίσως η Αποκάλυψη της ΤΝ που θα έπρεπε να μας ανησυχεί είναι στην πραγματικότητα η μαζική απώλεια θέσεων εργασίας που προκαλείται από την αυτοματοποίηση, ή η σταδιακή απώλεια ανθρώπινης δεξιότητας καθώς η ΤΝ αναλαμβάνει όλο και περισσότερες εργασίες, ή η περαιτέρω ομογενοποίηση του πολιτισμού, που προέρχεται από την τέχνη, τη μουσική και τον κινηματογράφο που δημιουργούνται από την ΤΝ.

Ή ίσως πρόκειται για μια παγκόσμια ύφεση που προκαλείται από κατάρρευση στην τιμή των μετοχών εταιρειών τεχνολογίας που έχουν πείσει τους επενδυτές να τους δώσουν δισεκατομμύρια με υπερβολικές υποσχέσεις για υπερ-ευφυείς μηχανές που είναι χρόνια πιο μπροστά από τις ισχυριζόμενες. Αυτά τα σενάρια μου φαίνονται πολύ πιο πιθανά, και πολύ πιο κοντινά.